En la campaña presidencial de 2024 no se materializaron grandes cambios en la desinformación con el impulso de la inteligencia artificial (IA) generativa. Sin embargo, en diversas contiendas del ciclo electoral de 2025 hemos documentado cómo está ganando terreno esta tecnología capaz de producir –con mayor facilidad y calidad y a menor precio que antes– videos realistas, deepfakes y audios sintéticos.

A través del uso de deepfakes –videos hiperrealistas que pueden recrear la cara, los movimientos y la voz de una persona con IA- tantos partidos políticos como otras organizaciones de interés político no solo crearon avatares de sus contrincantes diciendo frases que nunca pronunciaron, en debates políticos que nunca ocurrieron, sino que también generaron versiones caricaturescas para ridiculizarlos.

Aquí te presentamos 3 ejemplos de usos de IA en las campañas de 2025.

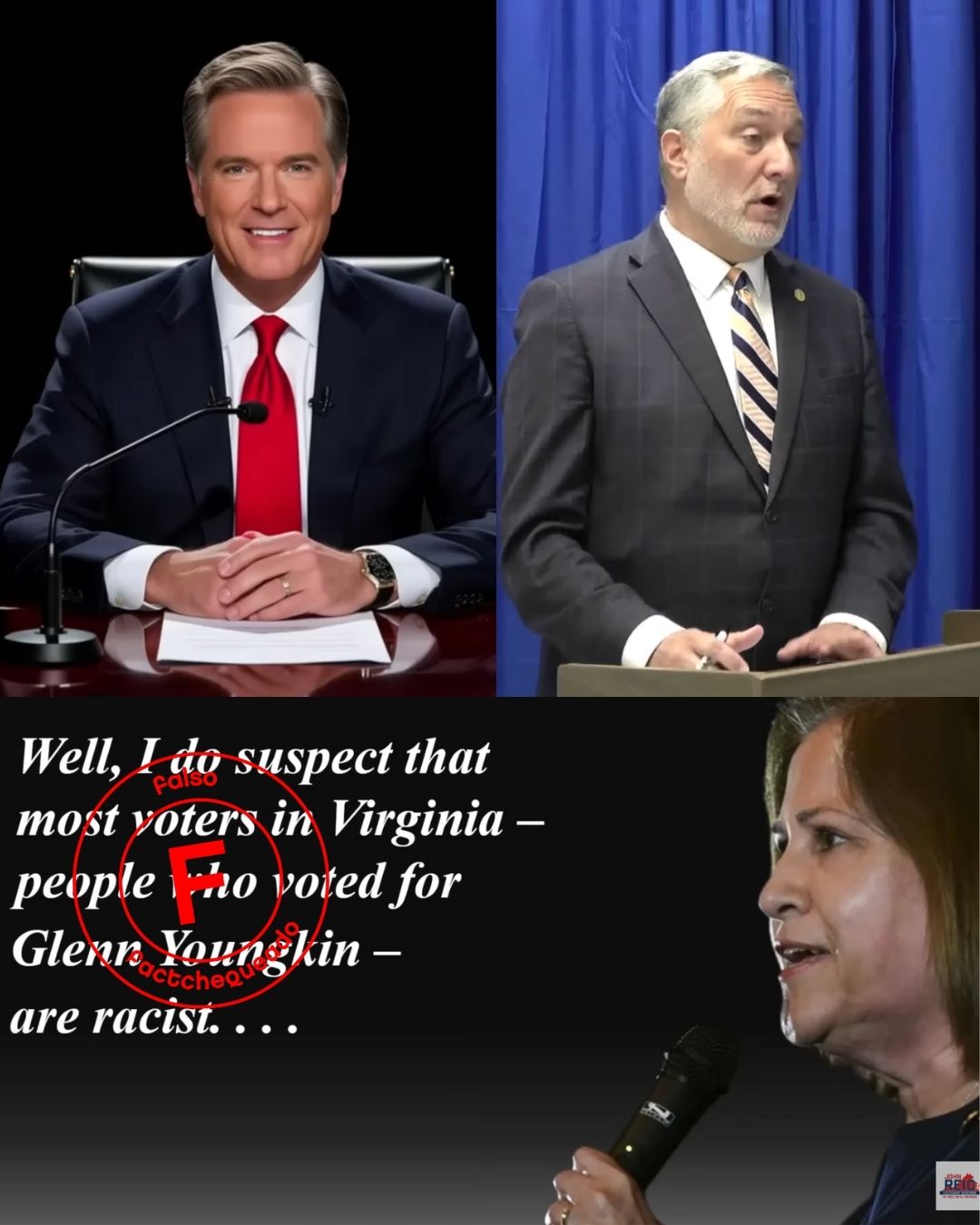

1) Virginia: supuesto “debate” entre el candidato republicano para vicegobernador y “respuestas” de su contrincante generadas con IA

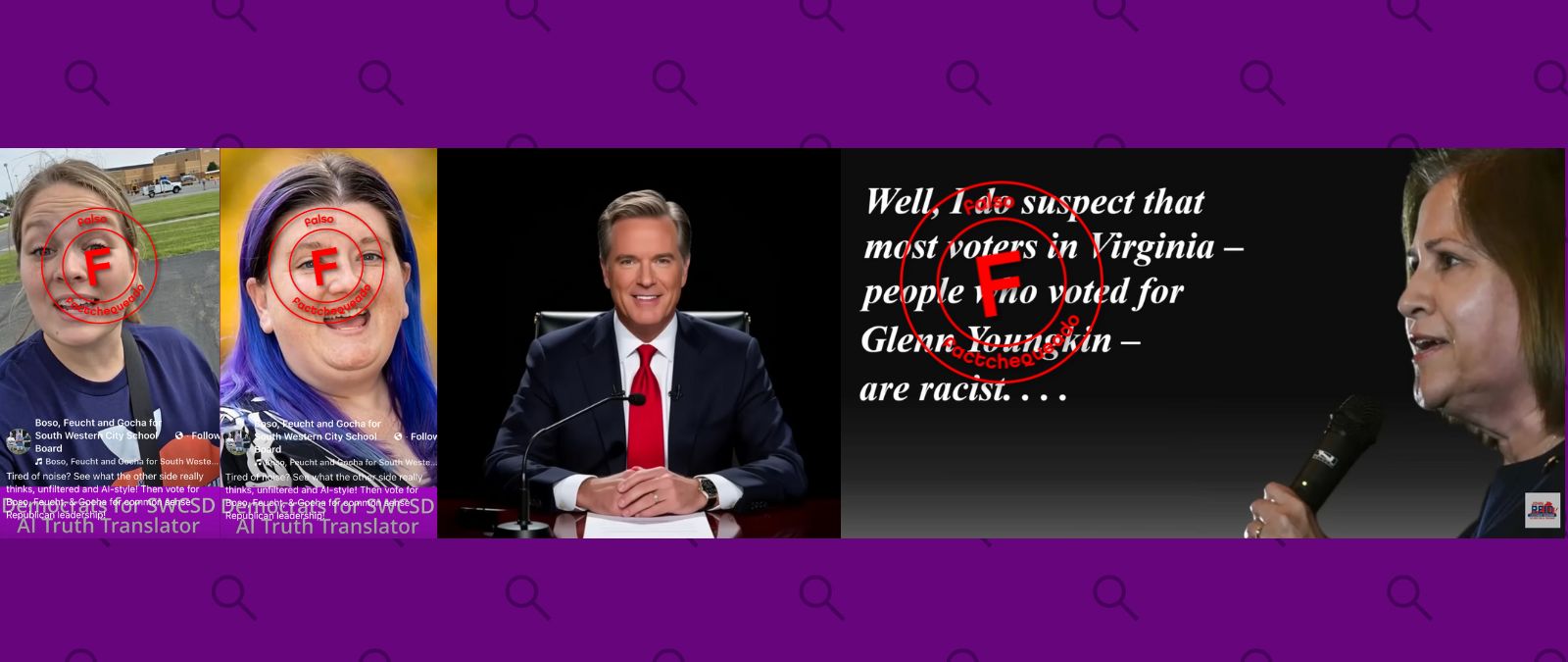

El candidato a vicegobernador republicano de Virginia, John Reid, transmitió el 21 de octubre de 2025 desde su cuenta de YouTube un supuesto “debate” con su contrincante, la demócrata Ghazala Hashmi.

En la descripción del video de 42 minutos se especifica que las palabras de Hashmi fueron generadas con IA “utilizando sus declaraciones públicas verificadas”. Sin embargo, en el minuto 37:25 la voz generada con IA dice “sospecho que la mayoría de los votantes de Virginia (...) son racistas” y en Factchequeado no encontramos comentarios públicos de Hashmi afirmando esto.

En el supuesto “debate” se afirma que la fuente de esta frase es el portal conservador “The Gateway Pundit”. Revisamos ante este portal, que a su vez cita a otro portal conservador (Free Beacon) y ahí llegamos a un video de 2021 donde supuestamente Hashmi hizo esa afirmación. Cuando lo vimos, notamos que la candidata nunca dijo eso, sino que fue el entrevistador quien afirmó que “es preocupante que aceptemos el argumento (...) de que la mayoría de los votantes en Virginia son racistas o susceptibles a mensajes con lenguajes racistas”.

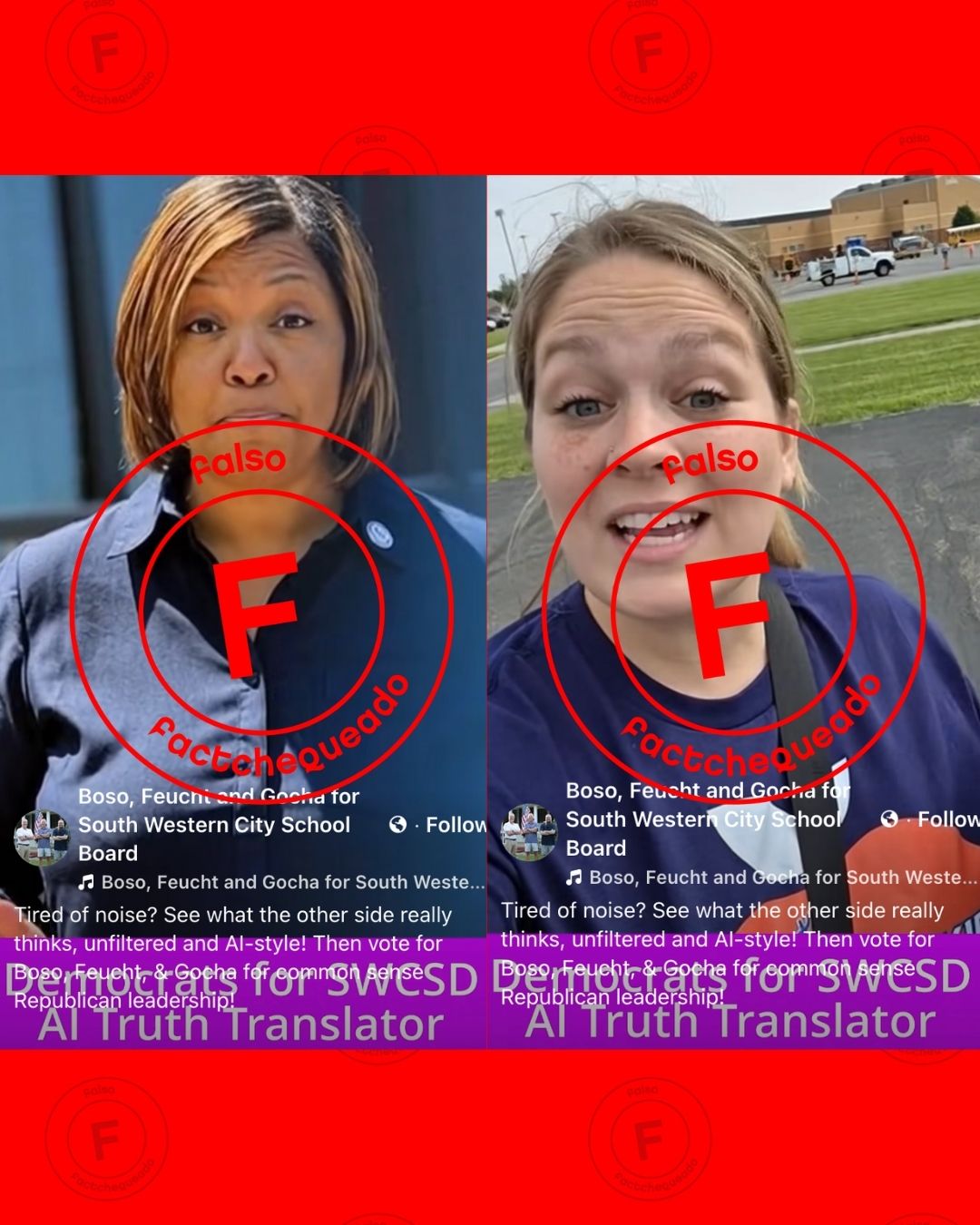

2) Ohio: video deepfake de candidatas a la Junta Escolar de South Western City

En la página de Facebook de los aspirantes a la Junta Escolar, Chris Boso, Steve Feucht y Jason Gocha (respaldados por el Partido Republicano), se publicó el 27 de octubre de 2027 un video generado con IA de sus oponentes, Camille Peterson, Chelsea Alkire y Kelly Dillon.

En el video de 17 segundos –que afirma mostrar “lo que el otro lado realmente piensa, sin filtro y con estilo IA”– aparece una versión de AI de Dillon diciendo que no se levanta durante el juramento de lealtad a la bandera de Estados Unidos, una de Alkire diciendo que si ganan aprobarán un aumento del 1,000% en el sueldo de los profesores, y otra de Peterson diciendo “estoy rodeada por liberales locos y necesito su voto”.

3) Texas: video deepfake de candidato al Concejo Municipal de Dallas

Durante la campaña para las elecciones del Concejo Municipal de la Ciudad de Dallas, Texas, en junio de 2025, una cuenta de X (llamada @dallasenfuego) circuló un video con varios deepfakes del candidato Jeff Kitner.

El contenido utiliza un audio real de Kirchner tomado de una entrevista que dió a Loserville (un podcast de politica local de Dallas) y con el que generaron un video falso del candidato con una camiseta manchada. Kirchner perdió la elección frente a Bill Roth, que obtuvo el 53.8% de los votos.

Esta técnica es similar a la empleada por el Comité Nacional Republicano del Senado, que tomó parte de una frase del líder de la minoría demócrata, Chuck Schumer, publicada en un medio de comunicación, en la que Schumer refiere al cierre del gobierno, afirmando: “Cada día se pone mejor para nosotros”, en relación a la estrategia demócrata. Con ese material, el comité generó y publicó un video deepfake de Schumer con un audio sintético que imita su voz y en el que el senador aparece pronunciando esas palabras y luego, aparentemente, sonríe. La frase es real, pero el audio y el video no lo son.

¿Cómo podemos prepararnos y protegernos contra la desinformación para otras elecciones locales y las midterms de 2026?

A pesar de los avances de la IA y del aumento de su uso en la política estadounidense, nuestro sentido común sigue siendo la mejor herramienta para no caer en las trampas de quienes intentan manipularnos.

Por eso en Factchequeado desarrollamos el método SABE: Sospecha, Analiza, Busca, Evalúa. Cuatro pasos sencillos que todos podemos seguir para blindarnos contra la desinformación, incluyendo la que circula durante campañas electorales.

Sospecha: que un candidato o campaña afirme que su contrincante dijo algo (especialmente si ese “algo” es controversial) no significa que sea cierto.

Analiza: cuando te llegue un contenido alarmante o controversial en campaña analízalo con calma. Observa si las imágenes o el audio tienen alguna falla.

Busca: corrobora con las cuentas oficiales del candidato o en medios de comunicación o periodistas confiables si realmente el candidato dijo la supuesta frase controversial y, de ser cierta, en qué contexto la dijo.

Evalúa: tras haber indagado utilizando los pasos anteriores, puedes determinar si la información que te llegó es genuina o si están intentando manipularte con desinformación.

Si no encuentras información verificada sobre el tema, nos puedes contactar a través de nuestro WhatsApp (+1 (646) 873 60 87) para que en Factchequeado hagamos el trabajo de averiguar si es verdadero, falso, o si necesita contexto o mayor explicación.

Puedes leer con más detalle cómo funciona el método SABE en esta nota de Factchequeado.

Factchequeado es un medio de verificación que construye una comunidad hispanohablante para contrarrestar la desinformación en Estados Unidos. ¿Quieres ser parte? Súmate y verifica los contenidos que recibes enviándolos a nuestro WhatsApp +1 (646) 873 60 87 o a factchequeado.com/whatsapp.