En noviembre de 2025, una mujer de Nueva Jersey le pagó a un estafador después de recibir una llamada en la que le dijeron que su hermana había sido secuestrada. La mujer afirma que escuchó el llanto característico de su familiar durante la llamada, pero los investigadores dicen que la voz de la hermana fue generada con IA. En realidad, su hermana estuvo a salvo en su apartamento todo ese tiempo.

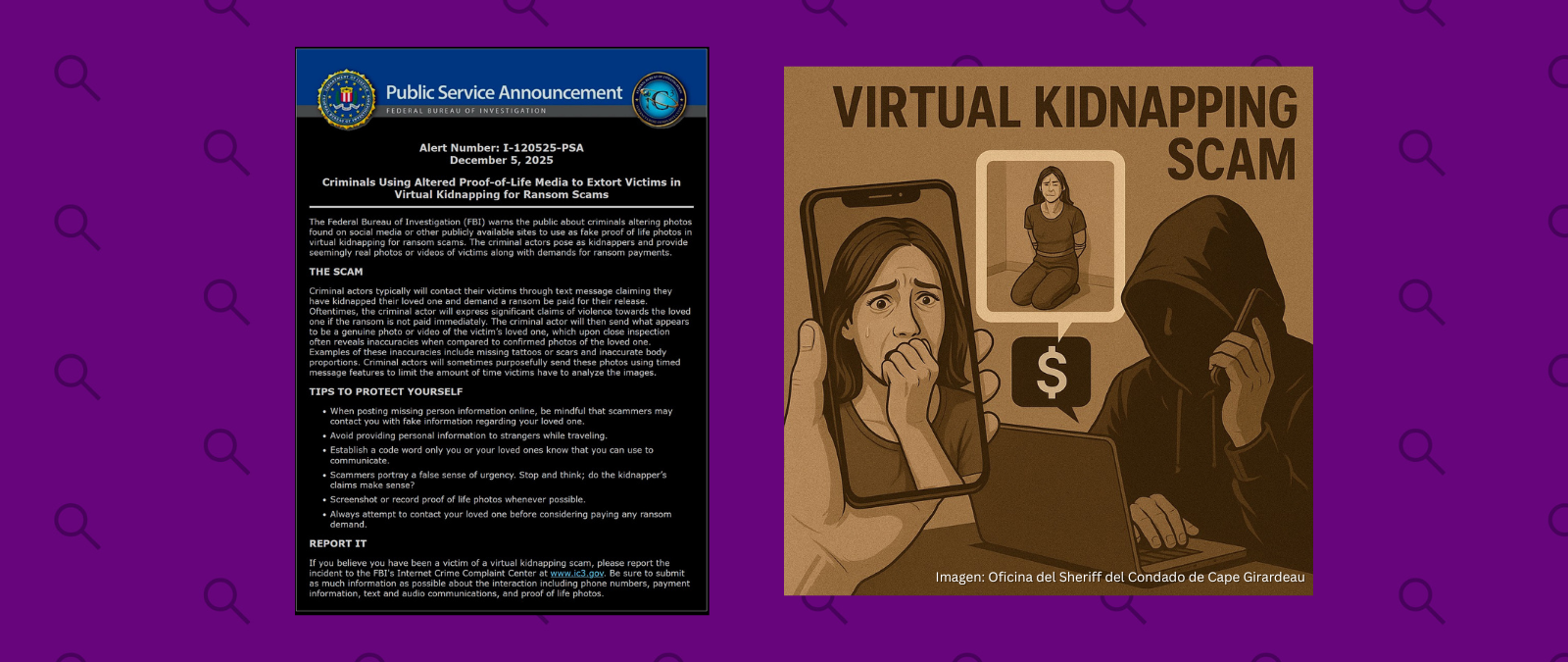

El FBI (Buró Federal de Investigaciones) advirtió que sobre casos como este donde “delincuentes están utilizando material audiovisual manipulado para extorsionar a sus víctimas en estafas de secuestro virtual con fines de rescate”, el 5 de diciembre de 2025. A esto se lo conoce como “estafa de secuestro virtual”. La oficina del alguacil del condado de Cape Girardeau, en Missouri, dijo en sus redes sociales que “los avances en inteligencia artificial (IA)” harían más compleja la detección de la estafa.

Estas estafas usualmente comienzan con un mensaje de texto a las víctimas afirmando que tienen secuestrado a uno de sus seres queridos mientras exigen un rescate para su liberación. En ocasiones, amenazan con infligir violencia y posteriormente envían la “prueba de vida” (proof of life), una foto o video del “secuestrado” que parece ser auténtico. También, según explica el FBI, pueden utilizar las funciones de mensajes con temporizador “para limitar el tiempo que las víctimas tienen para analizar las imágenes”.

Sin embargo, el material compartido puede tener varias inconsistencias al compararlo con imágenes reales de la persona. “Estas inconsistencias incluyen la ausencia de tatuajes o cicatrices y proporciones corporales inexactas”, indica el FBI.

Desde Factchequeado encontramos que en septiembre y abril de 2025, los departamentos de policía en California y Texas, respectivamente, reportaron múltiples llamadas en las que afirmaban que habían secuestrado a un ser querido y exigían un rescate. Sin embargo, no especificaron si los estafadores utilizaron imágenes o videos manipulados.

Te compartimos los consejos del FBI para que no caigas en este tipo de estafas que es una de varias donde estafadores han hecho uso de la IA. Otros ejemplos, como te contamos en esta nota de Factchequeado, incluyen las estafas de romance o estafas de inversión.

Consejos para protegerte de las estafas con IA

De acuerdo con el FBI, estas son algunas de las medidas que puedes tomar en cuenta para prevenir este tipo de fraudes:

Ten presente que al compartir en redes sociales información sobre una persona perdida, los estafadores podrían contactarte con información falsa sobre tu ser querido.

Evita compartir información personal con extraños mientras viajas.

Establece una palabra clave que solo tú y tus seres queridos sepan y que pueden utilizar para comunicarse.

Los estafadores utilizan falso un sentido de urgencia. Ante esto es recomendable que te detengas y pienses: ¿Tiene sentido lo que dicen?

Realiza capturas de pantalla o graba las supuestas “pruebas de vida” que te mandan los estafadores.

Siempre trata de contactar a tu ser querido antes de considerar pagar un rescate.

Expertos dijeron a FOX 5 que puedes hacer preguntas que solo un ser querido pueda responder. Por ejemplo, qué comió la noche anterior, algún chiste que hayan compartido o el nombre de su restaurante favorito.

Repórtalo

En caso de haber sido víctima de esta estafa, el FBI recomienda reportar el incidente a su Centro de Denuncias de Delitos en Internet www.ic3.gov. También puedes reportar una estafa en español a la FTC en reportefraude.ftc.gov.

<iframe title="vimeo-player" src="https://player.vimeo.com/video/475917468?h=1f6ba1adb4" width="640" height="360" frameborder="0" referrerpolicy="strict-origin-when-cross-origin" allow="autoplay; fullscreen; picture-in-picture; clipboard-write; encrypted-media; web-share" allowfullscreen></iframe>

Factchequeado es un medio de verificación que construye una comunidad hispanohablante para contrarrestar la desinformación en Estados Unidos. ¿Quieres ser parte? Súmate y verifica los contenidos que recibes enviándolos a nuestro WhatsApp +16468736087 o a factchequeado.com/whatsapp.

Lee también:

Cómo se usa la inteligencia artificial (IA) en ‘deepfakes’ para estafar y cómo puedes protegerte

Cómo prevenir a los niños y adolescentes sobre el ‘phishing’ y otros fraudes online

Cómo detectar tú mismo si estás siendo víctima de una ciberestafa ('phishing')